공정함을 단어로 정의하는 것은 동의할 수 있지만, 구체적으로 말하면 그 구체적인 적용에 대해서는 추가 분석의 대상이 될 수 있습니다.

무엇이 공정하고 불공정한지를 정의하는 것이 사람들에게 진정한 딜레마가 될 수 있는 것처럼 인공 지능에 대한 도전이기도 하며 Michigan State University의 새로운 이니셔티브가 완화하고자 하는 과제이기도 합니다.

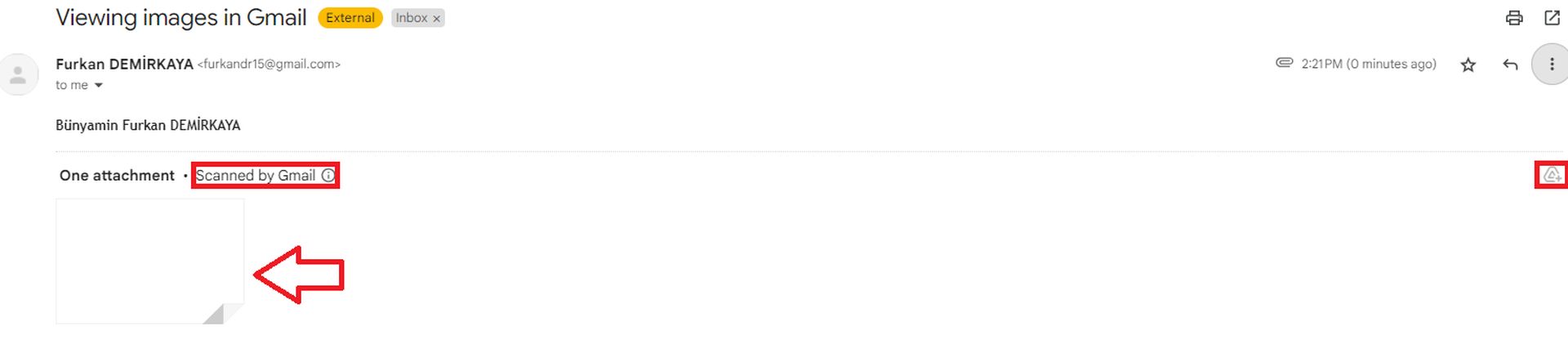

AI 알고리즘에 대한 공정성 클래스

일상적인 활동과 서비스에 인공 지능 시스템이 점점 더 많이 존재한다는 점을 고려할 때, 누가 적절한 의료 서비스를 받을 수 있는지, 누가 은행 대출을 받을 수 있는지, 누가 배정되는지를 결정하는 플랫폼에 충분한 공정성을 제공할 필요가 있습니다. 직업.

앞서 언급한 미국 대학의 컴퓨터 과학 및 공학부 교수이자 연구원인 Pang-Ning Tan은 Amazon과 국립 과학 재단의 자금 지원을 받아 작년에 인공 지능 알고리즘이 공정성과 그들의 행동의 불공정.

“우리는 컴퓨터 과학뿐만 아니라 사회에 가치와 혜택을 가져다주는 AI 시스템을 설계하려고 노력하고 있습니다. 그래서 지금 사회가 당면한 과제가 무엇인지 고민하기 시작했다”고 말했다.

이 프로젝트는 사용자에게 직접적인 영향을 미치는 이니셔티브를 개발할 필요성을 높입니다. 같은 점을 발전시키면서 Tan은 “형평성은 매우 큰 문제입니다. 특히 의료와 같은 일상적인 요구 사항에 대해 AI에 더욱 의존하게 됨에 따라, 스팸 필터링이나 뉴스 섹션에 기사를 넣는 것과 같이 평범해 보이는 것들에도 더욱 의존하게 됨에 따라 더욱 그렇습니다. .”

자동화된 시스템인 경우에도 AI 알고리즘은 교육에 사용된 데이터에서 특정 유전 편향을 전달하거나 제작자가 직접 전달할 수도 있습니다. 예를 들어 탄 교수팀이 실시한 설문조사에 따르면 AI 시스템이 입사 지원 시스템에서 의료 관리와 여성에 대한 성차별을 관리할 때 인종을 차별하는 사례가 있다.

이러한 현실에 대해 Tan의 연구팀 구성원인 Abdol-Hossein Esfahanian은 “알고리즘은 사람에 의해 만들어지고 사람은 일반적으로 편향이 있으므로 이러한 편향은 필터링됩니다. 우리는 모든 곳에서 공정성을 원하고 더 나은 평가하는 방법에 대한 이해.

사회 과학 이론의 지원을 받아 Tan과 그의 팀은 가능한 가장 보편적인 공정성 개념에 접근하려고 합니다. 이 목적을 달성하기 위해 알고리즘에 전달되는 공정성의 원칙은 단일 관점에서 나오지 않고 경쟁 또는 모순된 입장 사이에서 결정하도록 도전합니다.

“우리는 AI가 정의를 인식하도록 하려고 노력하고 있으며, 그렇게 하려면 무엇이 공정한지 알려야 합니다. 그러나 모든 사람이 수용할 수 있는 공정성을 어떻게 설계합니까?” Tan은 “우리는 결정이 개인뿐만 아니라 커뮤니티와 사회계에 어떤 영향을 미치는지 살펴보고 있습니다.”라고 덧붙였습니다.

이 작업은 야심차고 진척에도 불구하고 이제 막 시작되었습니다. “이것은 매우 지속적인 연구입니다. 많은 문제와 도전이 있습니다. 공정성을 어떻게 정의하고 사람들이 우리가 매일 사용하는 이러한 시스템을 신뢰하도록 도울 수 있습니까?”라고 Tan은 회상하며 “연구원으로서 우리의 임무는 이러한 문제에 대한 솔루션을 찾는 것입니다.”라고 덧붙였습니다.

이 연구의 전체 보고서는 Michigan State University 웹사이트에서 액세스할 수 있습니다.