혁신적인 웹 브라우저인 Opera가 획기적인 기능을 선보였습니다.

이제 브라우저에는 LLM(대형 언어 모델)을 개인용 컴퓨터에 직접 다운로드하고 실행할 수 있는 기능이 있습니다.

이 흥미로운 개발은 사용자에게 완전히 새로운 차원의 가능성을 열어 잠재적인 새로운 브라우저 기반 AI 통합 시대를 열었습니다.

LLM이란 무엇이며 왜 중요한가요?

LLM은 방대한 양의 텍스트 데이터에 대해 훈련된 복잡한 AI 모델입니다. 그들은 인간과 매우 유사한 텍스트를 생성하고, 언어를 번역하고, 다양한 종류의 창의적인 콘텐츠를 작성하고, 질문에 포괄적으로 답변할 수 있는 능력을 갖추고 있습니다.

몇 가지 인기 있는 예는 다음과 같습니다.

- 라마(메타 AI)

- ChatGPT(오픈AI)

- PaLM (구글 AI)

Opera의 지역 LLM 이니셔티브

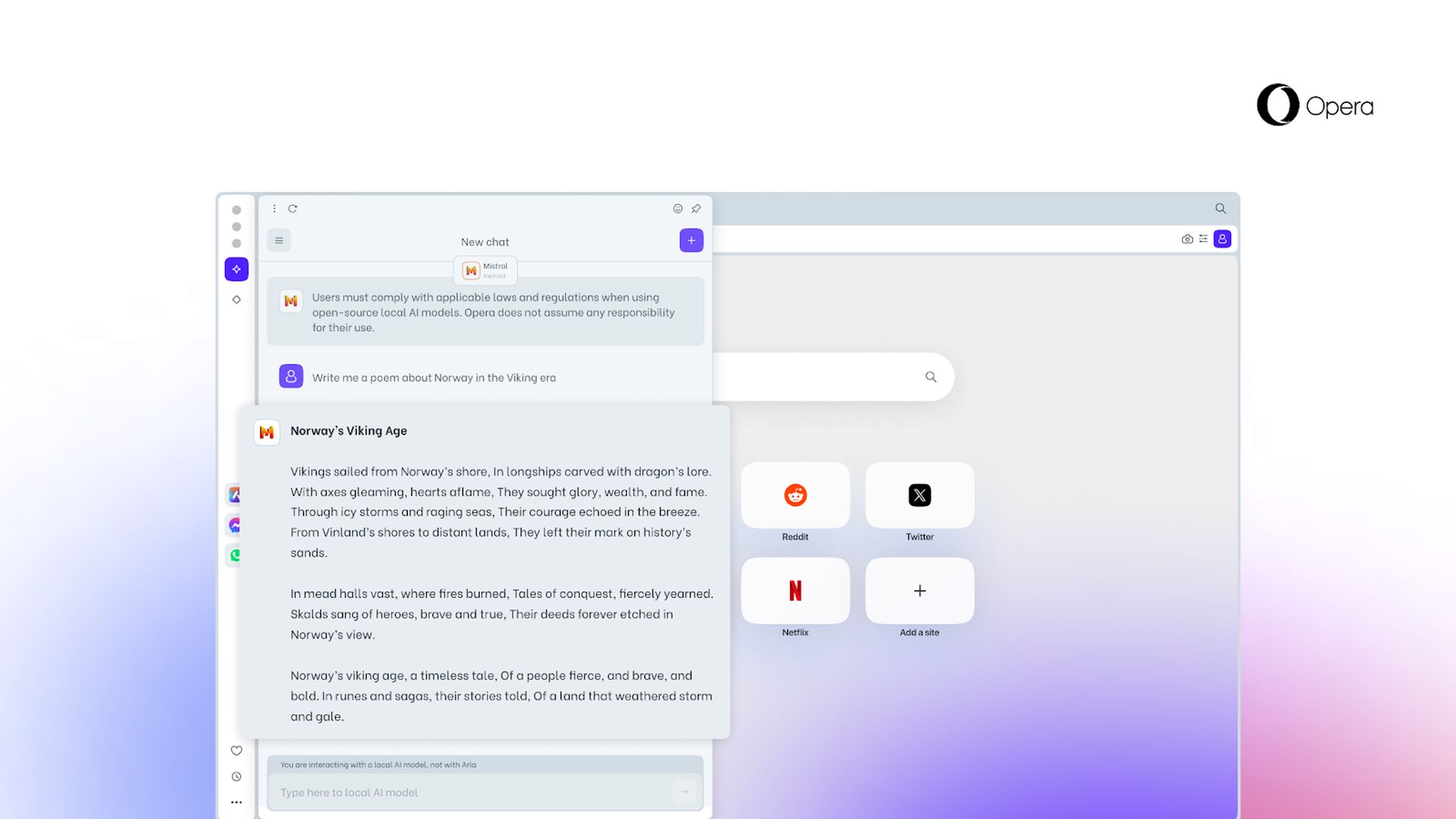

Opera는 이제 브라우저 내에서 직접 다양한 타사 LLM에 대한 액세스를 제공합니다. 사용자는 50개 이상의 제품군에 걸쳐 150개 이상의 모델로 구성된 라이브러리를 탐색할 수 있습니다. Meta의 Llama, Google의 Gemma 및 Vicuna와 같은 인기 있는 옵션의 가용성은 일상적인 사용자의 손에 상당한 AI 성능을 제공합니다.

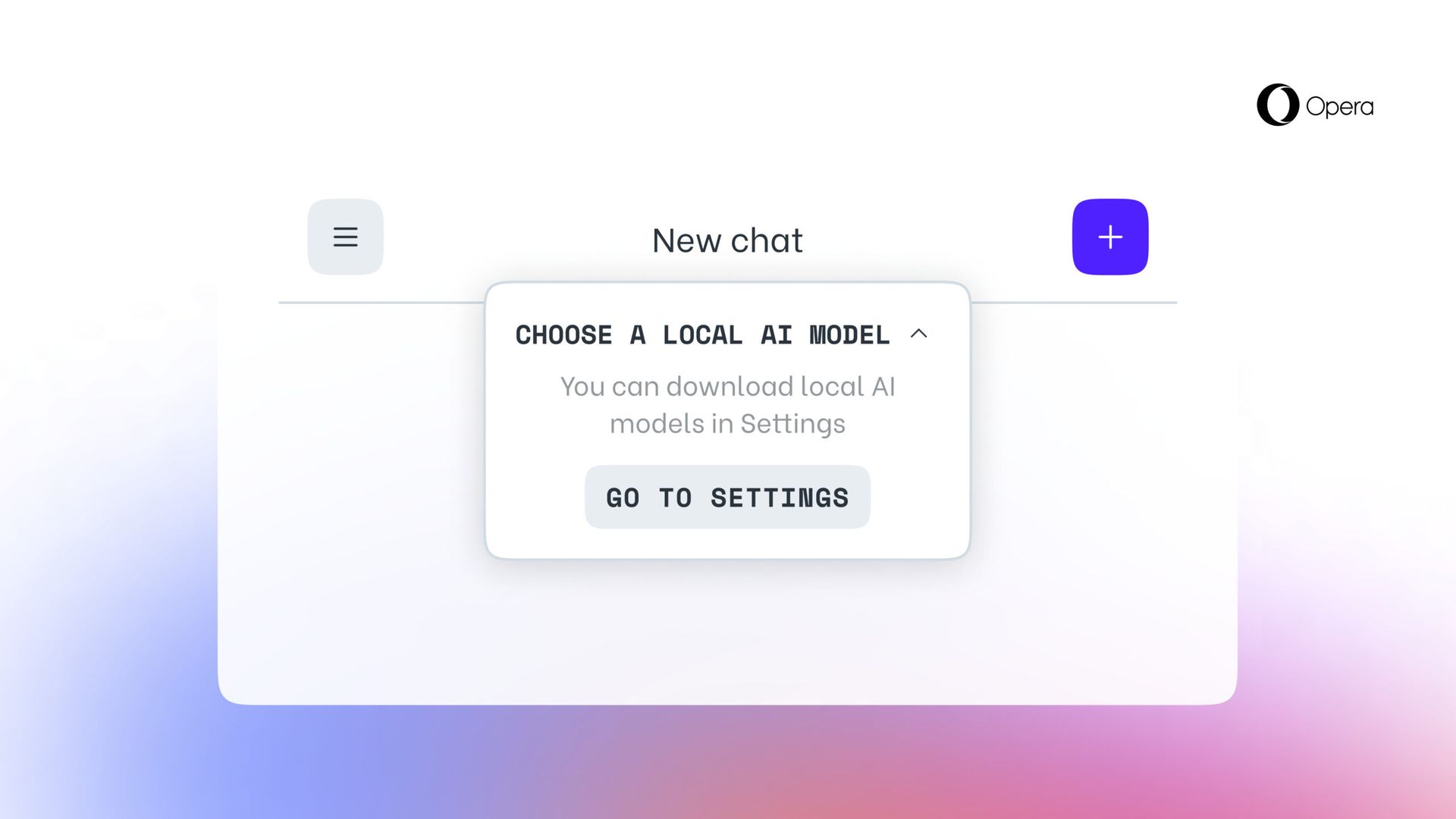

Opera에서 LLM을 다운로드하고 사용하는 과정은 3단계로 이루어집니다.

- 올바른 Opera 버전을 사용하고 있는지 확인하세요: LLM을 로컬로 다운로드하려면 “Opera One” 버전(개발자용) 또는 Opera의 실험적인 “AI 기능 드롭 프로그램”에 액세스할 수 있는 브라우저가 필요합니다.

- LLM을 찾아보세요: Opera의 LLM 라이브러리로 이동하여 사용 가능한 모델을 찾아보세요. 다양한 작업에 특화된 모델로 모든 사람을 위한 무언가가 있습니다.

- 다운로드 및 활성화: 원하는 LLM을 선택한 후 다운로드 프로세스를 시작하세요. 이러한 모델은 수 기가바이트의 하드 드라이브 공간을 차지할 수 있다는 점을 염두에 두십시오. 다운로드가 완료되면 브라우저 내에서 선택한 LLM을 활성화하세요.

LLM을 로컬에서 실행하면 다음과 같은 이점을 얻을 수 있습니다.

- 강화된 개인 정보 보호: 모델을 로컬에서 실행하면 데이터와 상호 작용이 장치 외부로 유출되지 않아 보안이 강화됩니다.

- 오프라인 기능: 인터넷 연결이 불가능한 경우에도 LLM을 사용하세요.

- 사용자 정의 옵션: 귀하의 특정한 필요와 선호도에 맞는 다양한 모델을 시험해 보십시오.

LLM을 로컬에서 실행하는 Opera의 기능은 AI 기반 브라우징 경험에 새로운 가능성의 세계를 열어줍니다. 이러한 모델이 계속 발전함에 따라 우리는 웹과 상호 작용하는 방식을 강화하는 더욱 창의적이고 유용한 통합을 기대할 수 있습니다.

Opera가 계속해서 한계를 뛰어넘는 가운데 이 흥미진진한 공간에서 더 많은 발전이 이루어지길 기대해 주세요.

주요 이미지 크레딧: 오페라

Source: Opera One 사용자는 이제 로컬에서 LLM을 사용할 수 있습니다. 방법은 다음과 같습니다