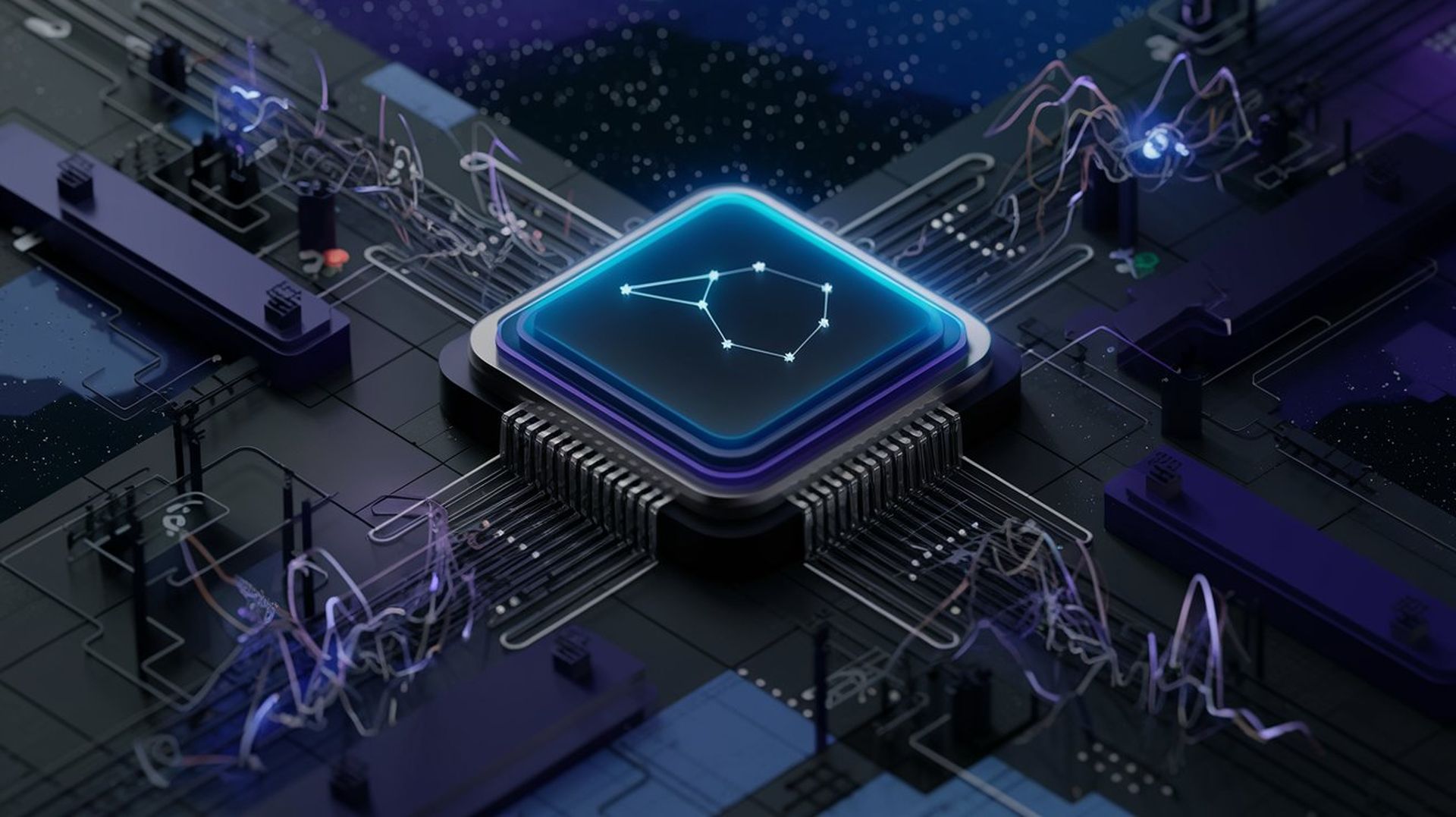

이번 주에는 AGI 준비 작업을 수행하는 OpenAI 팀의 수석 고문인 Miles Brundage가 회사를 떠나 헤드라인을 장식했습니다. AI 커뮤니티 내에서 점점 커지는 우려를 강조하는 움직임으로 Brundage는 다음과 같은 명확한 경고를 발표했습니다. 아니요. OpenAI나 다른 주요 AI 연구소조차도 일반 인공 지능(AGI)의 위험에 대해 완전히 준비되어 있지 않습니다.

이것은 심각한 질문을 제기하는 일련의 세간의 이목을 끄는 출구 중 가장 최근의 것입니다. AGI가 잠재적으로 사회에 영향을 미칠 수 없는 곳이 있습니까? 아마도 가장 진보된 실험실조차도 AGI가 사회에 미치는 잠재적인 영향을 관리할 준비가 되어 있지 않을 것입니다.

나는 방금 이 메시지를 동료들에게 보냈고 블로그 게시물에서 내 결정과 다음 단계에 대해 자세히 설명했습니다(다음 트윗 참조). pic.twitter.com/NwVHQJf8hM

— 마일스 브런디지(@Miles_Brundage) 2024년 10월 23일

OpenAI가 핵심 연구원을 잃으면서 AI 안전에 대한 우려가 커지고 있습니다.

Brundage의 이탈은 OpenAI의 일련의 이탈 중 가장 최근의 것이며, 최근에는 Brundage와 회사 및 리더십 사이에 다양한 정도의 거리를 두고 있습니다. 출발에는 최고 연구 책임자인 CTO Mira Murati가 포함됩니다. 밥 맥그루그리고 연구 부사장 바렛 조프회사가 우선순위를 명확히 했다는 구체적인 증거보다 더 그렇습니다. 부분적으로 그는 OpenAI에서 일하면서 경험했던 제약 없이 AI 정책 연구를 하고 싶었기 때문에 Brundage를 떠났습니다. OpenAI에서는 자신이 출판할 수 있는 공개 범위를 제한하려는 OpenAI의 욕구로 인해 점점 더 위축되는 느낌을 받았습니다. 이에 따라 OpenAI의 AGI 준비팀이 해체되었고, 이는 회사가 장기적인 안전 계획에 전념하고 있는지에 대한 우려를 불러일으켰습니다.

한편, AGI 개발은 사회가 책임감 있게 처리할 준비가 되어 있는 것보다 더 빠르게 가속화되고 있다고 Brundage는 작별 인사에서 말했습니다. 그는 “OpenAI나 다른 어떤 선도적인 연구실도 AGI를 위한 준비가 되어 있지 않으며 세상도 준비가 되어 있지 않습니다.”라고 썼으며 OpenAI의 경영진은 그의 평가에 동의할 수 있지만 회사의 상용화 방향으로의 전환은 안전에 초점을 맞춘 사명을 위태롭게 할 수 있다고 덧붙였습니다. OpenAI는 비영리 연구에서 영리 모델로 전환하고 상용 제품 제공이라는 이름으로 장기적인 고려 사항을 희생하면서 작업을 수익화하라는 압력을 경험한 것으로 알려졌지만 데이터가 나타낼 수 있는 한

브런디지의 경고는 혼자가 아닙니다. 이는 Jan Leike와 공동 창립자 Ilya Sutskever와 같은 주요 연구원이 떠난 직후에 발생하여 AI 개발과 안전 사이의 격차가 더욱 커지고 있습니다. 올해 초 Leike는 컴퓨팅 성능 부족 등 중요한 연구를 위한 충분한 자원을 수집하는 데 어려움을 겪었기 때문에 안전 팀을 해체했습니다. 이러한 내부 마찰과 외부 우려는 AI 연구소의 열망과 AGI의 잠재적으로 해로운 사회적 영향에 관해 세계의 글로벌 거버넌스 기계가 처리할 준비가 되어 있는 것 사이에 상당한 격차가 있음을 나타냅니다.

물론 전 OpenAI 연구원인 Suchir Balaji는 회사가 어떻게 안전보다 이익을 우선시하는지에 대해 이야기했으며 OpenAI를 저작권 침해로 비난하는 여러 소송에 대한 소문이 있습니다. Balaji의 퇴임과 Brundage의 점은 AI의 상업적 잠재력이 위험을 완화하려는 잠재적 노력을 능가한다고 믿는 연구자들 사이에서 점점 더 커지는 불안감을 강조합니다.

처음 OpenAI LP에 대해 들었을 때 걱정이 되었습니다. OAI의 비영리적 지위가 저를 매료시켰기 때문입니다. 하지만 그 이후로 제가 이 아이디어를 생각해낸 데는 두 가지 이유가 있습니다. 1. 세부 사항을 조사하면서 조직이 임무 중심을 유지하도록 하기 위해 많은 조치가 취해졌다는 것을 깨달았습니다.

— 마일즈 브런디지(@Miles_Brundage) 2019년 3월 11일

OpenAI가 안전 팀에서 주요 인물을 계속 잃으면서 AI 커뮤니티는 긴급한 질문에 직면했습니다. 왜 우리는 AGI 경쟁의 잠재적인 결과를 인식하지 못한 채 그렇게 빨리 AGI를 향해 경주하고 있습니까? Brundage의 이탈과 그 용량에 대한 더욱 극명한 경고는 AGI의 위험이 단순히 전쟁에서 패할 수 있다는 것만이 아니라는 점을 상기시켜 줍니다. 그럼에도 불구하고 우리는 그것을 통제할 수 있는 사회의 능력보다 앞서 경주하고 있습니다. AI 안전과 마찬가지로 AGI의 개발은 독립적인 경로를 추구하기로 선택하고 AGI 성장을 위해 덜 공격적이고 책임 있는 절차를 주장할 수도 있는 대체 핵심 연구원의 목소리에 달려 있습니다.

세계는 AGI가 사회에 반대하는 것이 아니라 사회를 위해 작동하도록 보장하는 책임을 지면서 이러한 선도적인 연구소가 혁신적일 수 있는지를 기다리고 있습니다. OpenAI 등이 주목을 받고 있습니다.

이미지 크레딧: 푸르칸 데미르카야/표의문자

Source: OpenAI는 최고 연구자들이 AI 준비 상태에 대해 경고하면서 불확실성에 직면해 있습니다.