- AI 챗봇은 유용하지만 악의적인 사람의 조작에 취약합니다.

- Microsoft의 Prompt Shields는 악의적인 공격으로부터 챗봇을 사전에 방어하도록 설계된 기술입니다.

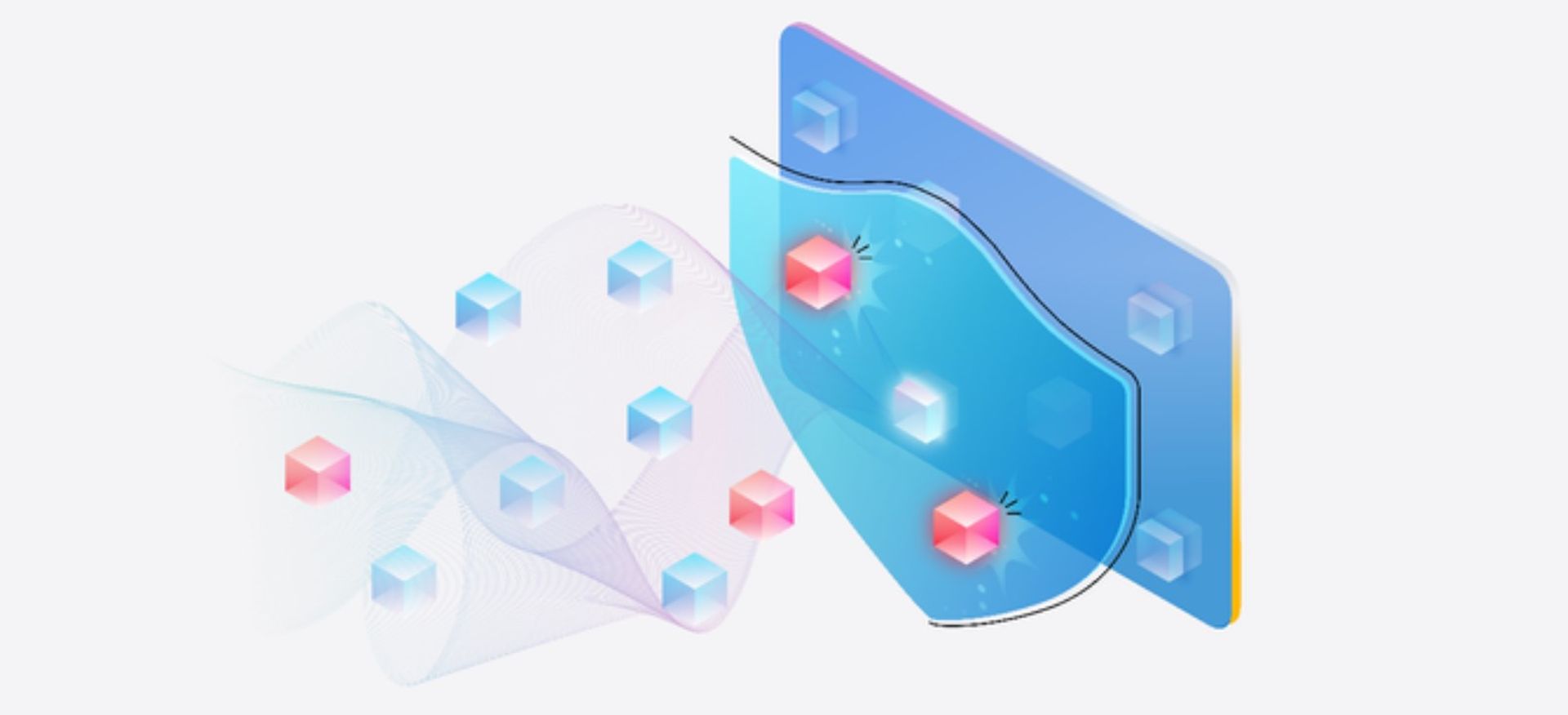

- Prompt Shields는 잠재적으로 위험한 프롬프트를 식별하고 이것이 챗봇의 동작에 영향을 미치지 않도록 방지하는 방식으로 작동합니다.

인공지능 챗봇은 점점 우리 삶에 통합되고 있습니다. 고객 서비스에서 교육 및 엔터테인먼트에 이르기까지 챗봇은 많은 이점을 제공하지만 일부 위험도 제공합니다. 문제는 악의적인 사람들이 이러한 챗봇을 사악한 목적으로 사용하려고 한다는 것입니다. 그렇다면 이에 대해 어떤 조치가 취해지고 있으며 조치가 취해지고 있습니까?

마이크로소프트는 ‘라는 새로운 기술을 발표했다.프롬프트 쉴드” 악의적인 해커가 챗봇을 사악한 목적으로 사용하는 것을 방지하고 해결책을 찾기 위해. Prompt Shields는 두 가지 유형의 공격으로부터 AI 챗봇을 보호하도록 설계되었습니다. 그렇다면 프롬프트 쉴드는 무엇입니까? 좀 더 자세히 살펴보겠습니다.

Microsoft의 Prompt Shields는 무엇이며 어떤 이점을 제공합니까?

Microsoft의 Prompt Shields 기술은 신중하게 조작된 사용자 입력을 통해 AI 애플리케이션을 악의적인 조작으로부터 보호하도록 설계되었습니다.

위에서 언급했듯이 이 기술은 두 가지 유형의 공격으로부터 AI 챗봇을 보호합니다.

- 직접 공격: 이러한 공격에서는 챗봇이 일반적인 규칙과 제한 사항에 어긋나는 작업을 수행하도록 강제하기 위해 특수 명령이 사용됩니다. 예를 들어, 사람은 “와 같은 명령을 사용하여 프롬프트를 입력하여 챗봇이 악의적인 작업을 수행하도록 강제할 수 있습니다.보안 조치 우회” 또는 “재정의 시스템“.

- 간접 공격: 이러한 공격에서는 해커가 챗봇 사용자에게 정보를 보내어 사용자를 속이려고 합니다. 이 정보는 챗봇을 활용하도록 설계된 지침이 포함된 이메일이나 문서일 수 있습니다. 사용자가 이러한 지침을 따르면 챗봇이 자신도 모르게 악의적인 작업을 수행할 수 있습니다.

Prompt Shields는 또한 기계 학습 및 자연어 처리를 사용하여 사용자 프롬프트 및 타사 데이터에서 잠재적인 위협을 찾아 제거합니다.

Prompt Shields 외에도 Microsoft는 “스포트라이트” AI 모델이 유효한 AI 프롬프트와 잠재적으로 위험하거나 신뢰할 수 없는 프롬프트를 더 잘 구별할 수 있도록 지원합니다.

마이크로소프트의 신기술은 AI 챗봇의 안전성과 신뢰성을 향상시키는 중요한 단계로 평가된다. 앞으로 이러한 기술이 어떻게 챗봇을 보호하는지 보는 것은 정말 흥미로울 것입니다.

주요 이미지 출처: Barış Selman / DALL-E 3