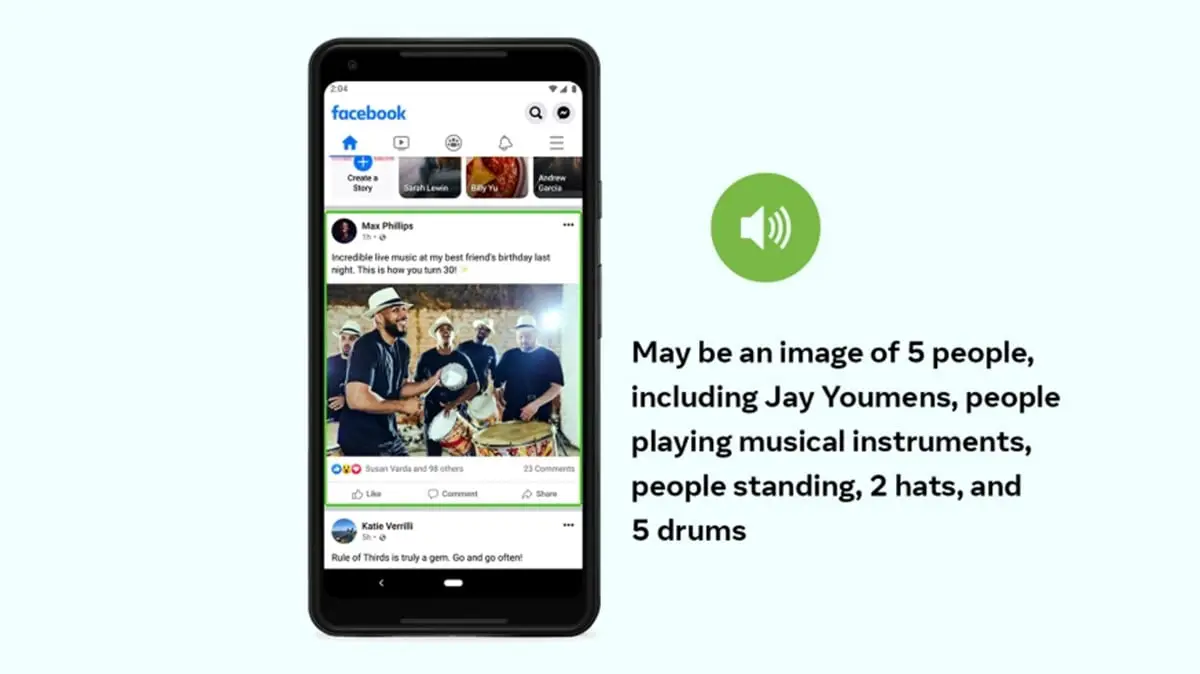

Facebook 팀은 시각 장애가 있는 사용자를 위해 설계된 기술인 플랫폼에 게시된 사진을 설명하는 데 사용하는 AI의 상당한 개선 사항을 발표했습니다.

2016년 페이스북이 디자인한 이 시스템은 보다 빠르고 정확한 다이내믹을 제공하기 위해 개선되었습니다. 그러나 최신 업데이트는 사진에 대한 더 자세한 설명을 제공할 수 있기 때문에 한 단계 더 나아갑니다.

페이스북, 시각 장애인 사용자를 돕기 위해 AI 개선

Facebook에 게시된 모든 이미지에 대해 인공 지능은 장면을 설명하는 자막을 자동으로 생성합니다. Facebook은 이 프로젝트가 이미지의 개별 요소만 설명하는 것이 아니라 전체 장면을 전달하여 사용자가 컨텍스트를 이해하고 게시물을 즐길 수 있기를 바랍니다.

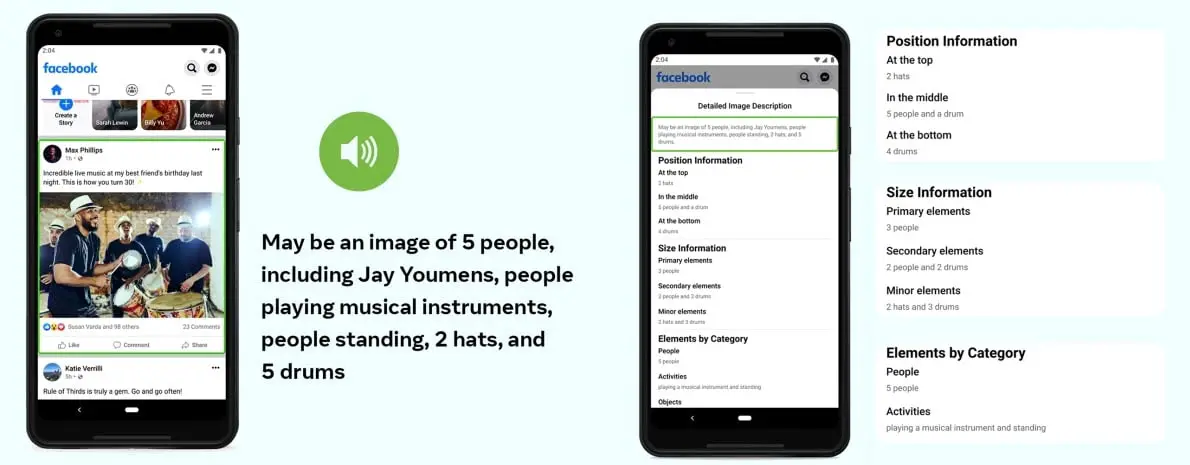

이 새로운 버전의 AI에 있는 목표는 이미 더 많은 요소를 인식하고 장면에 대한 더 자세한 설명을 제공할 수 있습니다. 사람인지 동물인지 구분할 수 있을 뿐만 아니라 다양한 유형의 활동, 장소, 심지어 요소의 위치까지 인식할 수 있습니다.

예를 들어 위의 이미지에서 인공지능은 모자를 쓰고 북을 치는 사람이 5명 있다는 것을 인식할 수 있었습니다. 그러나 그뿐만 아니라 장면이 어떻게 설정되고 어떤 요소가 중요한지 설명할 수도 있습니다. 사진에서 볼 수 있듯이 모든 정보는 장면의 전체 컨텍스트를 이해할 수 있도록 분류됩니다.

이 모든 정보는 시각 장애가 있는 사람들이 친구가 사진에서 공유하는 내용을 이해하는 데 도움이 됩니다. 물론, 그들은 피드에 나타나는 모든 사진에 대해 해당 정보를 얻고 싶지 않을 수 있으므로 Facebook은 더 자세한 설명을 받고 싶은 시기를 선택할 수 있도록 허용합니다.